要約

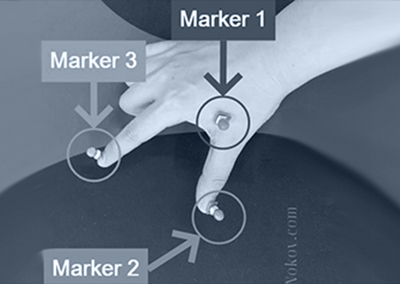

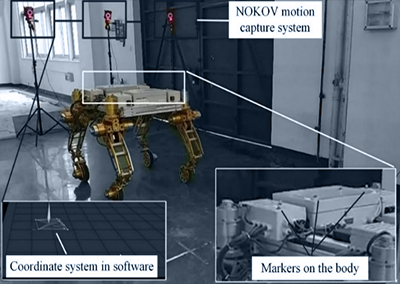

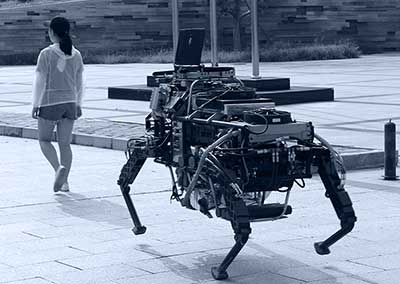

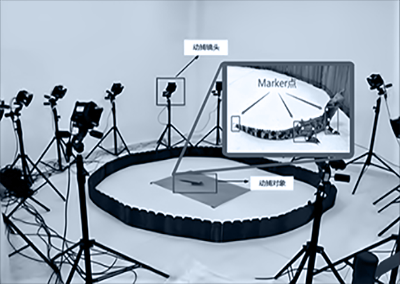

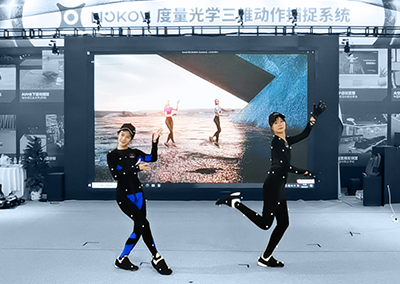

物体の正確な6Dポーズ追跡は、特にピン挿入のような複雑な組み立てシナリオにおいて、ロボット操作タスクにおいて非常に重要です。従来の視覚追跡方法は、特にロボットハンド操作を含むシナリオでは、視覚情報の遮蔽やノイズによって制約を受けることが多いです。本研究では、清華大学の学際情報科学研究所の李毅教授が率いるチームによって提案された新しい手法TEG-Trackを紹介します。この手法は、触覚センサーを統合することで一般的な6Dポーズ追跡の性能を向上させ、チームは実世界シナリオにおける手内物体ポーズ追跡のための初の完全に注釈付きの視覚-触覚データセットを構築しました。データ取得システムにはNOKOVモーションキャプチャシステムが含まれています。

GitHub: https://github.com/leolyliu/TEG-Track

引用文献

Y. Liu et al., "触覚センサーを用いた手内物体の一般化可能な6Dポーズ追跡の向上," IEEE Robotics and Automation Letters, vol. 9, no. 2, pp. 1106-1113, 2024年2月, doi: 10.1109/LRA.2023.3337690.

研究背景

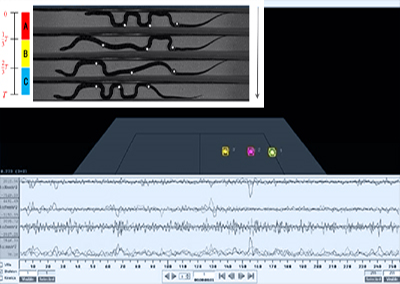

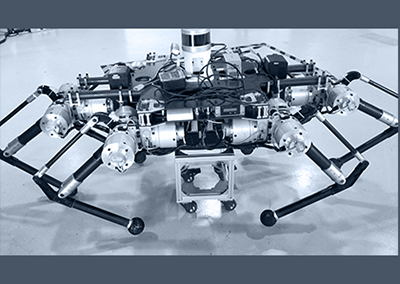

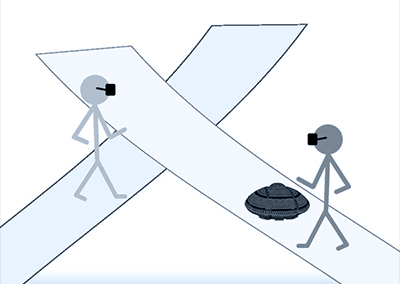

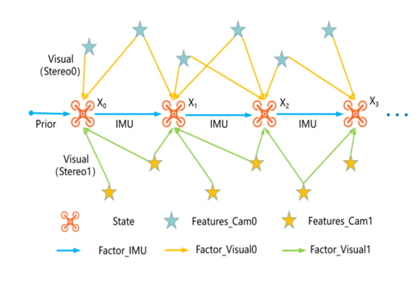

ロボット操作の信頼性は、手に持つ物体の動作状態を正確に認識することに依存しています。既存の6Dポーズ追跡方法は通常、RGB-D視覚データに依存しており、遮蔽や環境の衝突を伴うシナリオでは性能が低下します。それに対し、触覚センサーは接触領域の形状や動作情報を直接感知でき、追跡のための追加的な補助信号を提供します。

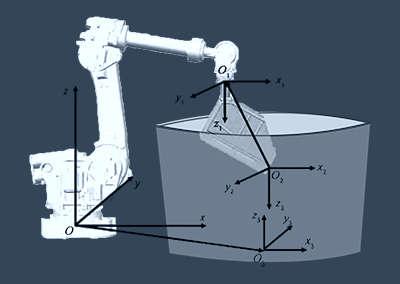

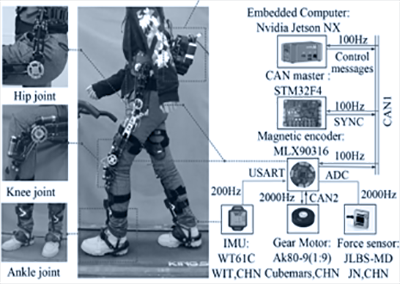

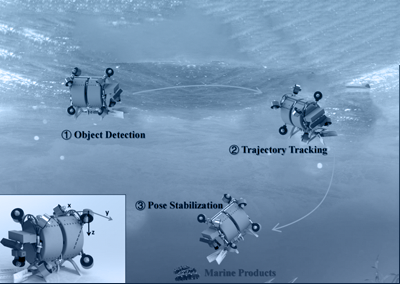

システムフレームワーク

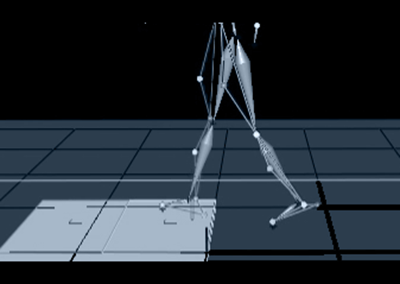

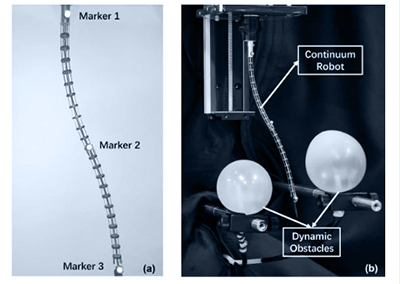

TEG-Trackの核は、幾何学的運動最適化戦略を通じて視覚ポーズトラッカーを強化するために触覚運動キューを使用することにあります。

データセット

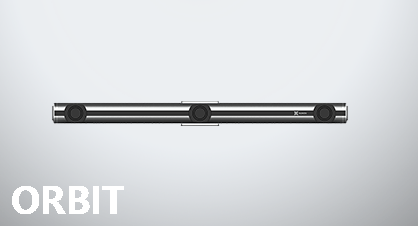

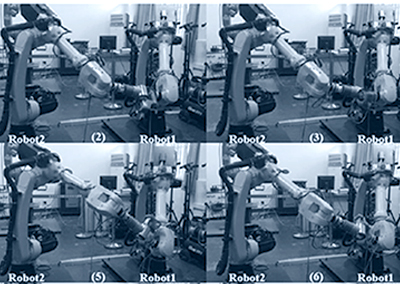

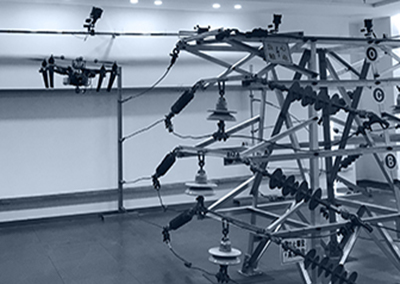

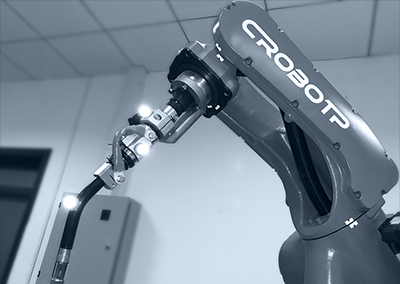

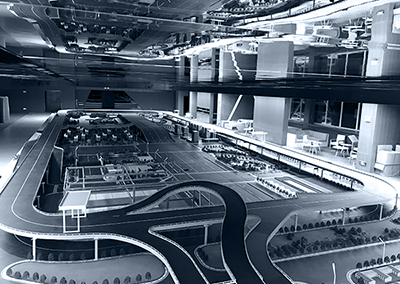

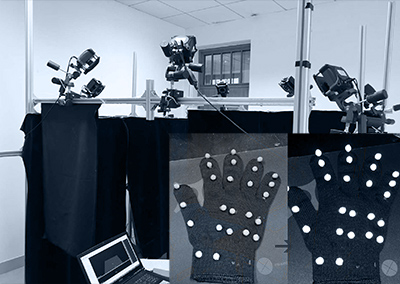

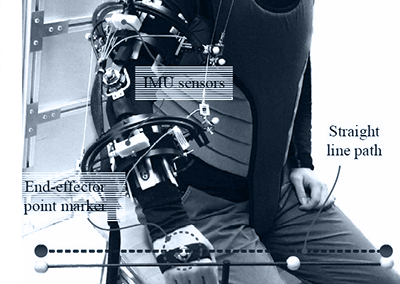

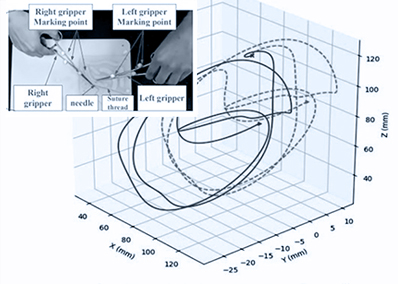

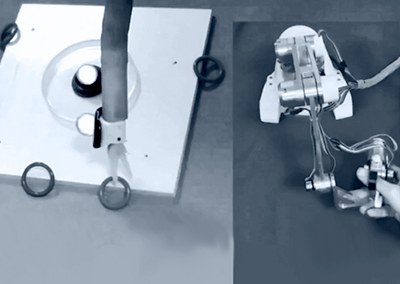

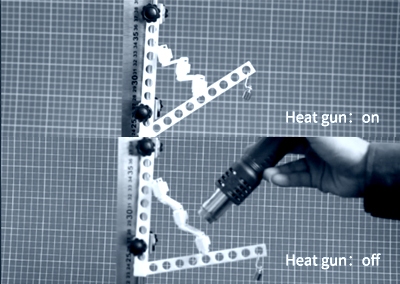

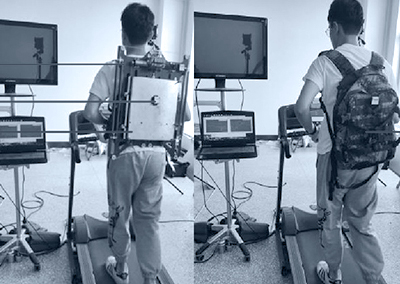

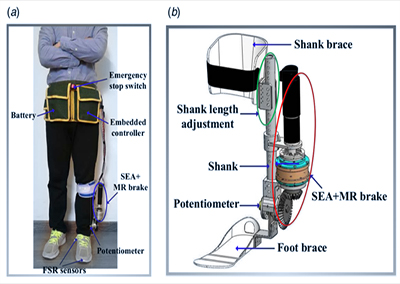

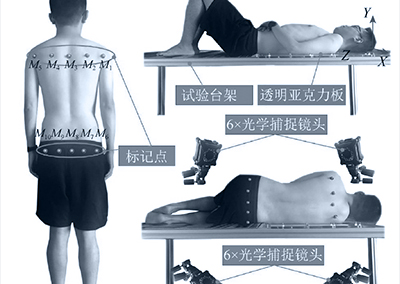

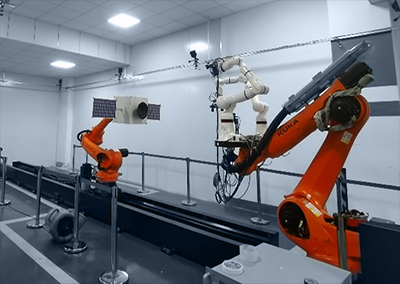

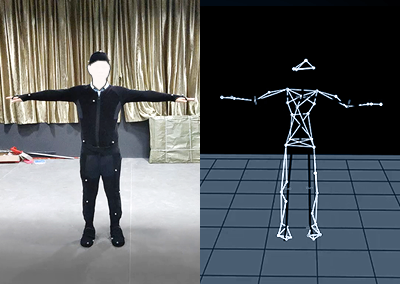

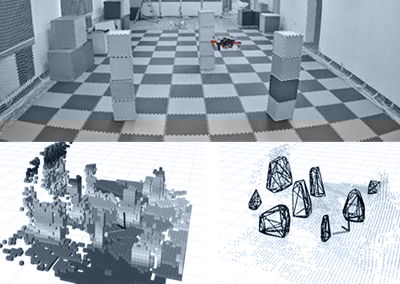

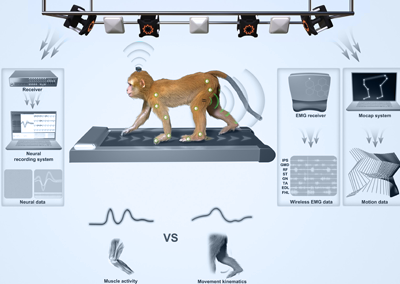

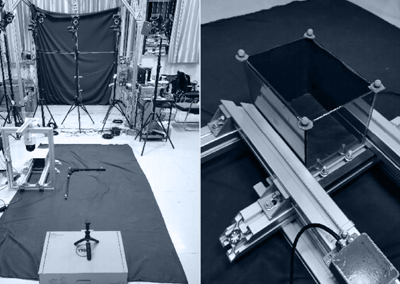

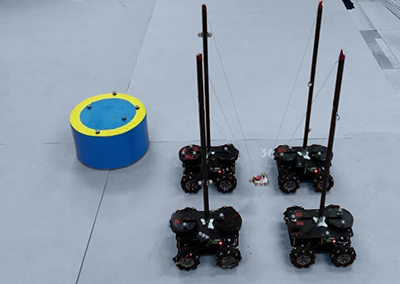

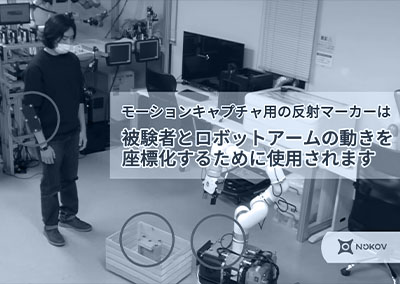

合成データセットにはShapeNetデータセットから選択されたさまざまな幾何学的形状の物体インスタンスが含まれており、実世界データセットは5つのカテゴリにわたる17種類の異なる物体をカバーする200本のビデオで構成されています。データ取得システムは、ロボットアーム、触覚センサー、RGB-Dセンサー、NOKOVモーションキャプチャシステム、および物体から成り立っています。

実験結果:

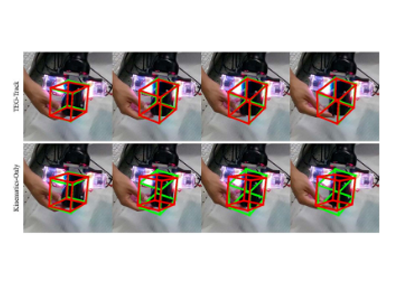

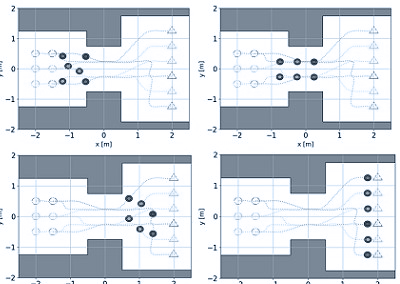

実験では、TEG-Trackが3種類の視覚トラッカー(キーポイントベース(BundleTrack)、回帰ベース(CAPTRA)、テンプレートベース(ShapeAlign))において性能改善を比較しました。結果は、TEG-Trackが実データにおいて平均回転誤差を21.4%、平行移動誤差を30.9%削減したことを示しています。 実データにおける長距離軌道の定性的結果は、手に持つ物体の予測ポーズと真のポーズをそれぞれ赤と緑のボックスで示しています。 触覚ノイズパターンをシミュレートすることにより、TEG-Trackの異なる品質の触覚信号下での性能がテストされ、触覚または視覚入力のみに依存するベースライン手法と比較して、より高い安定性と堅牢性が示されました。 TEG-Trackは、マルチフレーム最適化シナリオにおいて毎秒20フレームの処理速度を達成し、追加の計算コストが低いため、リアルタイムアプリケーションに適しています。 NOKOVモーションキャプチャシステムは、予測ポーズとの比較のために物体の真のポーズ情報を取得するために使用されます。

著者情報

共著者: 劉昀、博士課程学生、清華大学学際情報科学研究所

共著者: 徐霄萌、清華大学新雅書院

連絡著者: 弋力、上海起知研究所の主任研究者および清華大学学際情報科学研究所の助教授。研究興味は3D知覚、コンピュータグラフィックス、具現化された人工知能を含む。

ここでごニーズを出ること

-

もっと多い情報に関して、メッセージをしたりしてください。

-

- 確認