人間と機械の相互作用はバーチャルリアリティ技術の重要な特徴です。今日、スマートハードウェアの継続的な更新とモバイルネットワークの継続的な加速により、人間とコンピューターの相互作用方法が急速に発展し、その中でジェスチャーが最も人気のある人間とコンピューターです。今日の相互作用方法。現在、ジェスチャインタラクションは、スマートカー、ウェアラブルデバイス、自動車用電子機器、スマートフォンの分野で、新世代のヒューマンコンピュータインタラクションとして使用されています。

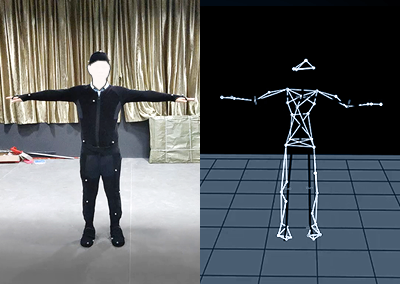

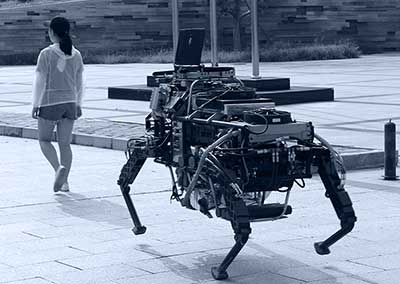

ジェスチャの相互作用を実現するための最初のステップは、ジェスチャデータの収集を完了することです。データ収集を実現するには、一般に2つの方法があります。カメラ画像に基づく視覚的なジェスチャキャプチャと、センサー追跡に基づく慣性ジェスチャキャプチャです。ただし、これら2つのジェスチャキャプチャ方法には、キャプチャの精度が不十分で、データノイズが多く、データの前処理が必要になるという欠点があります。ハルビン工業大学理学部のWangYifeng博士は、スマートブレスレットのジェスチャーの相互作用に関する研究を行っています。

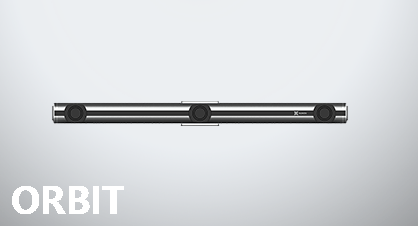

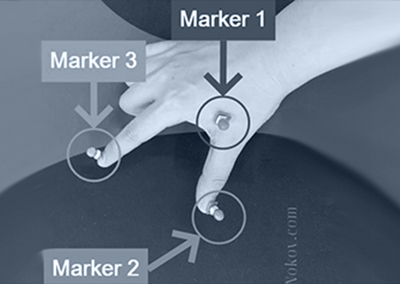

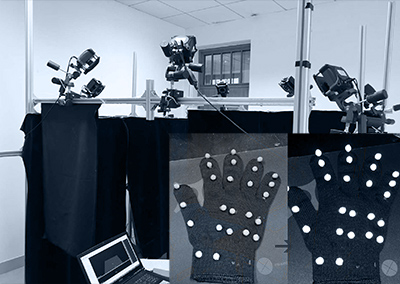

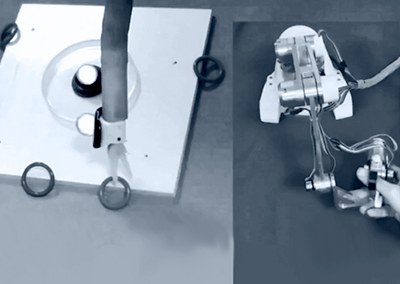

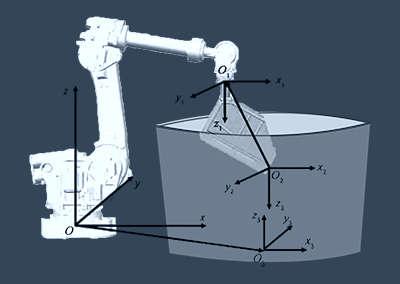

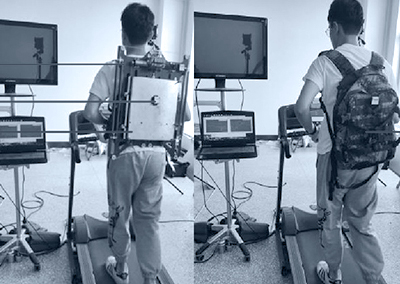

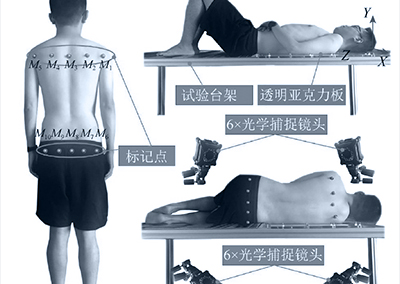

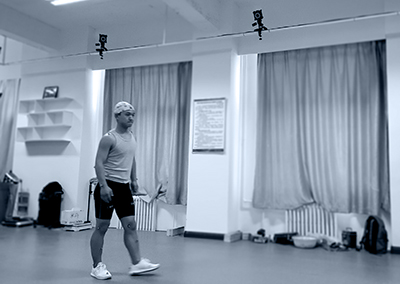

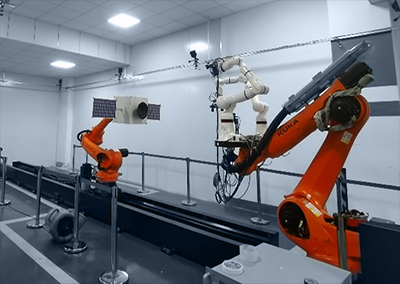

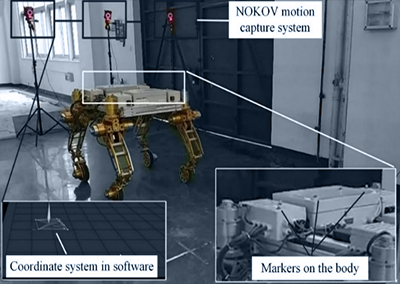

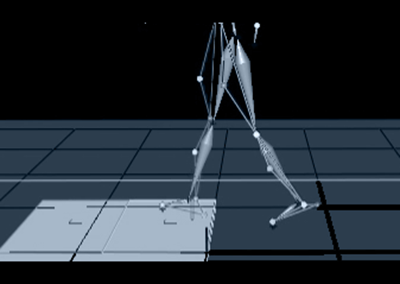

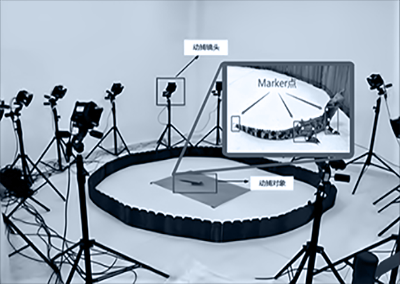

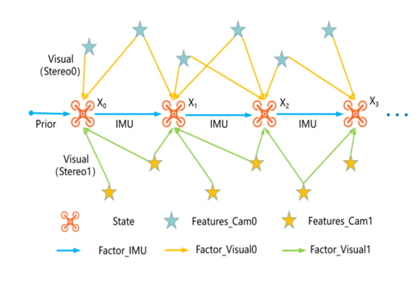

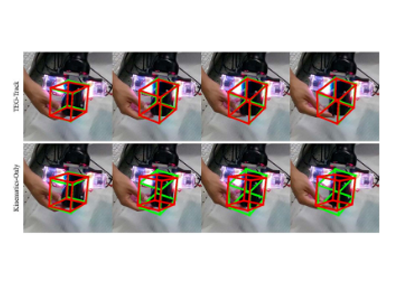

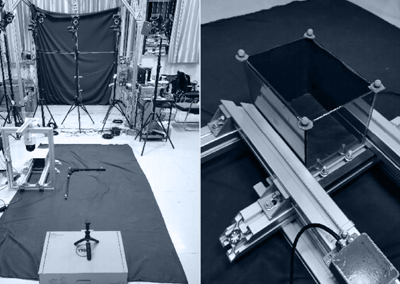

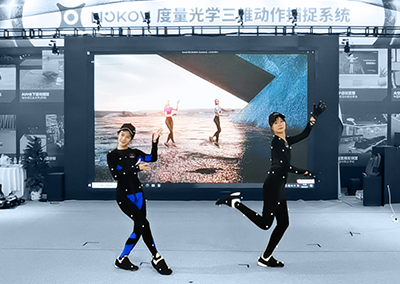

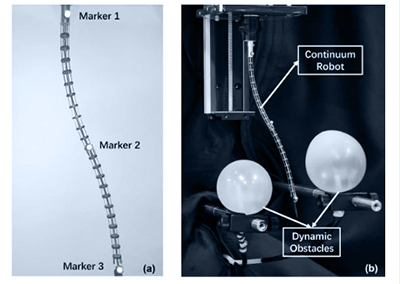

Wang Yifeng博士は、NOKOV光学3Dモーションキャプチャシステムを使用してジェスチャデータを取得します。赤外線光学系のモーションキャプチャシステムは、ブレスレットの表面に反射マーカーを取り付けることで、マーカーの3次元座標をリアルタイムで出力できます。ブレスレットを装着してジェスチャーを行うと、さまざまなジェスチャーの情報を反映できます。マーカーの位置の変化で、正確にサブミリメートルレベルに到達します。手の動きの速度、加速度、およびその他の情報も、モーションキャプチャシステムによって提供できます。これらのデータは、NOKOVモーションキャプチャによって提供される豊富なSDKインターフェイスを介してさまざまなシステムに直接インポートできます。これにより、研究者は大量のデータ前処理の時間を節約できるため、分類および認識アルゴリズムに関する研究をより適切に実行できます。

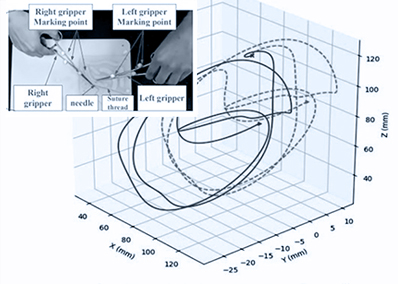

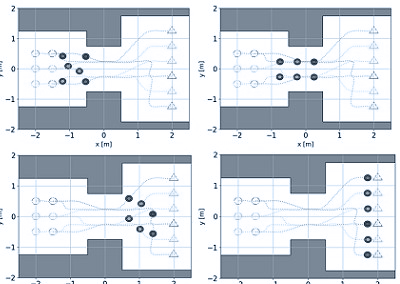

インポートされたデータ情報を通じて分類および認識モデルをトレーニングした後、アルゴリズム検証のテストサンプルとして26文字のジェスチャを使用し、正しい認識頻度、誤った分類カテゴリ、および連続リアルタイムテストジェスチャサンプルの頻度をカウントして、認識を完了します。および分類正解率分析。

ここでごニーズを出ること

-

もっと多い情報に関して、メッセージをしたりしてください。

-

- 確認